CEO Nvidia กล่าว AI ที่ฉลาดเท่ามนุษย์กำลังจะมาในอีกไม่เกิน 5 ปีข้างหน้า

การเติบโตของ AI นั้นมาพร้อมกับความหวาดกลัวในช่วงรอบปีที่ผ่านมา ตั้งแต่การที่ AI จะเข้ามาแย่งงานแย่งอาชีพ แทนที่จะสร้างงานให้กับผู้ใช้งาน ตลอดจนถึงหลายคนอาจจินตนาการถึงภาพยนตร์ที่ได้รับความนิยมอย่าง The Terminator หรือ The Matrix ที่ AI ครอบครองโลกและทำร้ายมนุษย์เลยทีเดียว ซึ่งสำหรับข่าวนี้นั้น ผู้ชื่นชอบในเทคโนโลยีอาจมีความตื่นเต้น แต่ถ้าผู้อ่านเป็นคนในกลุ่มข้างต้นอาจจะมีความกังวลใจมากขึ้นไปอีก

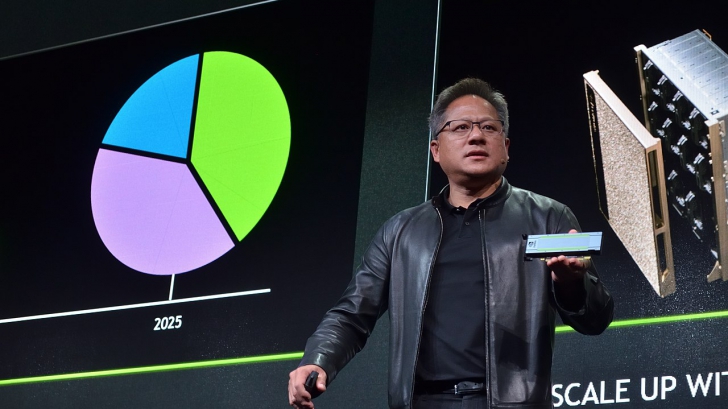

โดยในงานประชุมประจำปีของ Nvidia อย่างงาน GTC ในครั้งที่ผ่านมานั้น คุณ Jensen Huang ประธานเจ้าหน้าที่บริหารและผู้ก่อตั้งบริษัท ได้ขึ้นเวทีเพื่อพูดคุยถึงอนาคตของการพัฒนาปัญญาประดิษฐ์ หรือ AI (Articifial Intelligence) รวมถึงได้แบ่งปันความคิดส่วนตัวของเขาเกี่ยวกับประเด็นดังกล่าว ซึ่งสามารถสรุปได้ว่า “ถ้า AI นั้นหมายถึงโปรแกรมคอมพิวเตอร์ที่สอบผ่านข้อสอบเฉพาะทาง เช่น ข้อสอบทางการแพทย์ หรือข้อสอบเนติบัณฑิต แถมทำได้เก่งทำได้ดีกว่ามนุษย์ล่ะก็ มันจะทำได้แน่ในอีกไม่เกิน 5 ปีข้างหน้า”

- Nvidia ประกาศ GeForce Now จะสนับสนุนการสตรีมมิ่งความละเอียดระดับ 4K 120 บน TV ของ LG บางรุ่น

- อัปเดตผลิตภัณฑ์ใหม่ และ AI กับก้าวต่อไปของธุรกิจ ในงาน HP Next : Powering Secure Innovation for Business

- รู้จัก AI ยุคใหม่ บน LG AI TV บนทีวี OLED, QNED ปี 2025

- พาชมโซลูชั่นของ HPE กับอนาคต AI, EDGE Computing และ Hybrid Cloud ในงาน HPE Discover More AI Bangkok 2024

- HyperCubes ระบบระบายความร้อนแบบใหม่สำหรับ Data Center ลดอัตราการใช้พลังงานได้ถึง 50% สู้วิกฤตพลังงาน AI

โดย AI ระดับสูง หรือที่เรียกว่า Advanced General Intelligence (AGI) นั้นมักจะถูกขนานนามว่าเป็น AI ที่เหมือนมนุษย์ (human-like AI) ที่มีความสามารถในการทำงานเฉพาะทางบางอย่างได้เทียบเท่า หรือเก่งกว่ามนุษย์ ซึ่งสร้างความกังวลใจให้กับหลายคนว่า แล้วมนุษย์นั้นจะมีบทบาทเช่นใดในอนาคตถ้า AI เหล่านี้เก่งกว่า และฉลาดกว่ามนุษย์ในงานทุกแขนง

ขณะเดียวกันนั้นคุณ Huang ก็ได้เน้นย้ำว่า การที่เราจะทำนายได้ว่า AGI นั้นจะพัฒนาได้สำเร็จหรือจะมาในช่วงเวลาใดนั้น เราต้องทำการสร้างนิยามที่ชัดเจนให้กับ AGI ให้ได้เสียก่อน มิฉะนั้นก็จะไม่สามารถทำนายได้ว่า AGI นั้นจะมาถึงในช่วงเวลาใด

นอกจากนั้นแล้ว ในช่วงถามตอบภายในงาน คุณ Huang ยังได้กล่าวถึงข้อผิดพลาดสำคัญในชื่อว่า “ภาพลวงตาแห่ง AI” (AI Hallucinations) ซึ่งหมายถึงความมั่นใจของ AI ในการตอบคำถามที่ดูดีเหมือนจะถูกต้อง แต่แท้จริงนั้นเป็นคำตอบที่ผิด โดยคุณ Huang ได้เสนอวิธีแก้ปัญหาด้วยการนำเอา “retrieval-augmented genration” เข้ามาใช้งานบนตัวระบบ AI ซึ่งเป็นระบบที่จะช่วยชี้นำให้ AI สามารถค้นคว้า และตรวจสอบความถูกต้องของข้อมูลก่อนที่จะแสดงผลคำตอบให้กับผู้ใช้งาน

คุณ Huang ยังย้ำเตือนอีกว่า AI ควรมีความสามารถในการยอมรับตนเองถ้าไม่สามารถค้นหา หรือแสดงผลคำตอบที่ถูกต้องได้ หรือลังเลว่าคำตอบไหน ? เป็นคำตอบที่ถูกต้อง ซึ่งเป็นปัญหาที่เกี่ยวข้องกับสิ่งที่คุณ Huang กล่าวมาข้างต้น ถึงความมั่นใจเกินเหตุของตัว AI อันนำมาสู่การแสดงผลคำตอบผิด ๆ

ที่มา : timesofindia.indiatimes.com

คำสำคัญ »

คำสำคัญ »

|

|

ข่าวไอทีที่เกี่ยวข้อง

ซอฟต์แวร์

ซอฟต์แวร์ แอปพลิเคชันบนมือถือ

แอปพลิเคชันบนมือถือ เช็คความเร็วเน็ต (Speedtest)

เช็คความเร็วเน็ต (Speedtest) เช็คไอพี (Check IP)

เช็คไอพี (Check IP) เช็คเลขพัสดุ

เช็คเลขพัสดุ สุ่มออนไลน์

สุ่มออนไลน์